Корпоративные ИИ-ассистенты обещают быструю отдачу, но на деле могут создавать новые риски, от утечек данных до некорректных решений. Этот текст исследует, почему «умный чат» сам по себе не является полноценным бизнес-инструментом и какая инженерная инфраструктура необходима для эффективной и безопасной автоматизации, отделяя ее от дорогостоящих заблуждений.

Когда в компании впервые внедряется мощная большая языковая модель (LLM), часто повторяется один и тот же сценарий: руководство стремится предоставить ей широкий доступ к документам, CRM и почте, ожидая быстрого создания умного помощника. Однако спустя месяц становится очевидно, что вместе со скоростью появились новые проблемы: сотрудники бесконтрольно передают конфиденциальные данные, критически важные документы попадают в общедоступные векторные базы, а модель начинает давать уверенные, но ошибочные ответы. Вскоре возникает желание наделить ее полномочиями для совершения реальных действий.

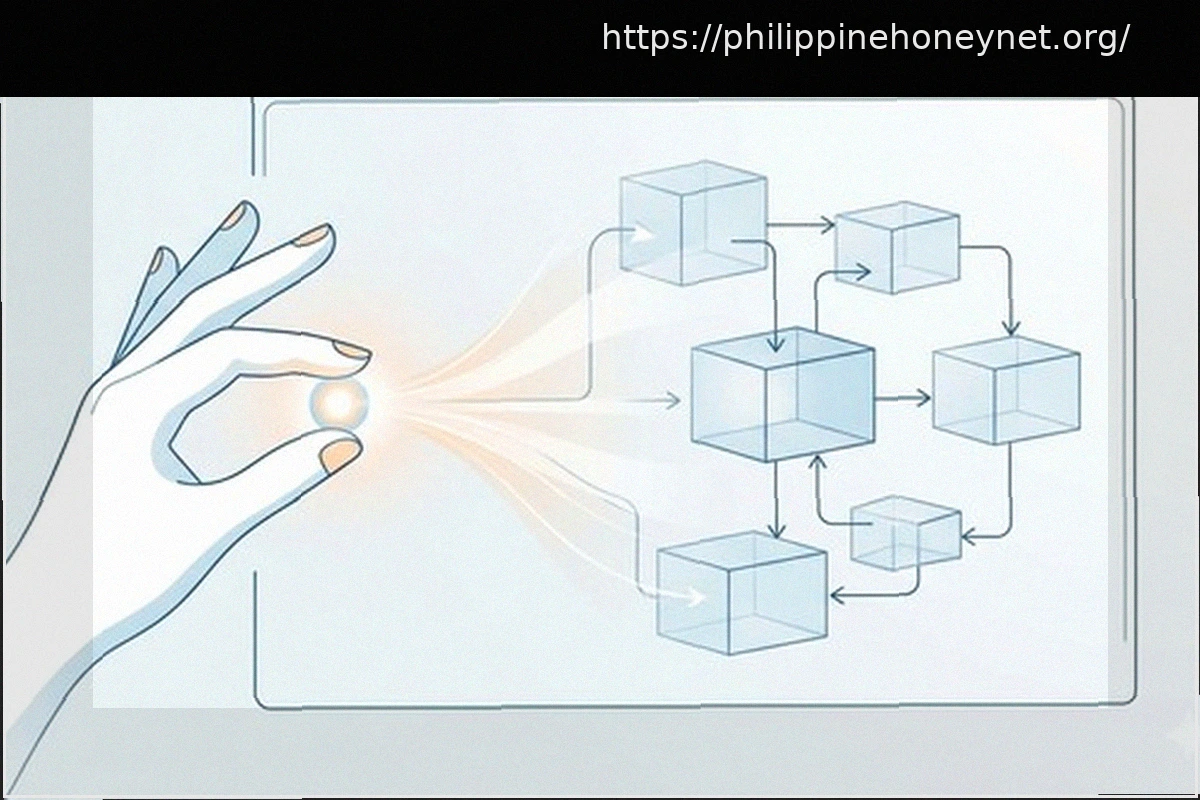

Здесь и кроется ключевая ошибка. Корпоративный ИИ часто внедряется как изолированный инструмент. На самом деле, его следует проектировать как интегрированную, управляемую экспертную систему – не просто как чат с удобным интерфейсом, а как контролируемый рабочий контур с четко определенными границами данных, правами доступа, источниками информации, журналированием всех операций и понятной зоной ответственности.

За последний год я многократно наблюдал одну и ту же картину: компании, попробовав несколько популярных моделей, привыкли к мгновенной генерации текста, и у руководства появилось ложное ощущение, что до создания полноценного корпоративного ассистента остался всего один шаг. Именно в этот момент начинаются самые дорогостоящие заблуждения. Кажется, что если модель хорошо генерирует текст, она уже готова к работе с внутренними процессами. Но на деле между красивым ответом в чате и функциональным бизнес-помощником лежит огромный пласт невидимой инженерии.

Именно в таком контролируемом режиме виртуальные ассистенты для руководителей, коммерческих отделов, поддержки или операционного управления начинают приносить ощутимую пользу. Они способны оперативно агрегировать данные по KPI, выявлять отклонения, находить нужные регламенты, сопоставлять факты из различных систем и подготавливать черновые варианты решений. Однако их функционирование не должно быть абсолютно свободным и бесконтрольным.

Где корпоративный ИИ действительно помогает

ИИ наиболее эффективен там, где присутствует большой объем однотипной интеллектуальной рутины, и где первичная ошибка не приводит к серьезным последствиям. К таким областям относятся: создание черновиков писем и справок, краткие выжимки из объемных документов, поиск по внутренней базе знаний, классификация повторяющихся запросов, проведение первичной аналитики, а также формирование утренних сводок по ключевым показателям и отклонениям.

В одном из наших проектов мы разработали ассистента для руководителя коммерческого блока. Ранее аналитик ежедневно вручную собирал данные из CRM, систем задач, отчетов по воронке продаж и комментариев из регионов, что занимало часы и приводило к устареванию информации к моменту совещания. После внедрения ассистент стал автоматически генерировать утренний дайджест, указывая на просадки по этапам, задержки сделок, аномалии по филиалам и, что крайне важно, предоставляя ссылки на первоисточники. Мы сразу установили правило: никакой ответ без опоры на разрешенный источник. Если данных недостаточно, ассистент прямо сообщает об этом.

Аналогичная ситуация наблюдалась в сервисном контуре, где команде приходилось вручную обрабатывать поток заявок, контролировать SLA и постоянно сверяться с меняющимися правилами маршрутизации. Первоначальный сценарий казался простым: предоставить модели доступ к базе знаний, тикетам и внутренним инструкциям. Однако на практике выяснилось, что без тщательной сегментации источников и строгого разграничения ролей, ассистент начинает смешивать оперативные подсказки для первой линии поддержки с внутренними комментариями руководства. Со стороны это может выглядеть как незначительная доработка, но именно такие «мелочи» внутри проекта определяют, станет ли ИИ надежной опорой для команды или источником дополнительного напряжения.

Где начинается лишняя работа

Проблемы обычно возникают не в самой модели, а на более ранних этапах – когда команда слишком увлекается технологией, забывая о первоначальных целях проекта. Первая зона риска – это контекст. Пользователи быстро осознают, что в чат можно загружать письма клиентов, фрагменты договоров, внутреннюю переписку, скриншоты с цифрами и другие файлы. Для компании это означает появление еще одного рабочего канала, через который циркулируют данные. Следовательно, этот канал должен управляться с той же дисциплиной, что и корпоративная почта, файлообменники и мессенджеры. В противном случае, данные будут передаваться через ИИ-систему бесконтрольно, просто потому, что это быстрее.

Вторая зона риска – это Retrieval Augmented Generation (RAG) и векторные базы данных. На словах это кажется безопасным: мы не дообучаем модель на корпоративных данных, а лишь предоставляем ей доступ к документам. Однако на практике возникают дополнительные риски: кто имеет право загружать документы в индекс? Наследуются ли права доступа от исходной системы? Что происходит с устаревшими версиями документов? В одном пилотном проекте мы остановили запуск на этапе тестирования, когда обнаружили, что ассистент поддержки имел доступ к значительно большему количеству инструкций, чем это было разрешено оператору первой линии. Проблема была не в модели, а в том, что в индекс попало слишком много информации.

На демонстрациях, как правило, все выглядит безупречно: три вопроса, три точных ответа, несколько ссылок на документы – и кажется, что система почти готова к полноценной работе. Настоящая проверка начинается позже, когда возникают сложные вопросы об исключениях, устаревших версиях регламентов, внутренних пометках и спорных случаях. У нас не раз бывало, что после успешного прототипа приходилось не расширять, а сужать контур доступа, так как именно там и скрывался основной риск.

Третья зона риска – это действия. Пока ассистент лишь предоставляет информацию, ущерб обычно ограничен качеством ответа. Но когда ему предоставляется право создавать задачи, изменять статусы, отправлять письма, инициировать платежи или вызывать внешние инструменты, уровень риска кардинально меняется. Здесь действует простое правило: объем доступа для чтения может быть шире, чем для действий. Для совершения любых действий необходим отдельный контур подтверждения.

Самая недооцененная угроза

Самая серьезная и недооцененная угроза связана не столько с прямой утечкой данных, сколько с подменой инструкций через внешние источники. Модель, обрабатывая письма, вложения, веб-страницы, PDF-файлы, тикеты или записи из базы знаний, не всегда способна различить полезный контент от посторонней команды. Если в документ подмешана вредоносная инструкция, ИИ-агент может воспринять ее как часть рабочего контекста. Поэтому сценарии, где ассистент читает внешние документы и при этом имеет возможность совершать действия, следует относить к категории повышенного риска. В таких случаях одной лишь настройкой проблему не решить – требуется непрерывный мониторинг всего рабочего цикла системы.

Как выглядит безопасная архитектура

Для создания безопасного корпоративного ассистента не существует универсального решения. Эффективна только многослойная архитектура.

Сначала необходимо определить матрицу сценариев: для каких ролей нужен ассистент, какие задачи он решает, к каким данным имеет доступ, какие действия разрешены, а какие категорически запрещены. Уже на этом этапе становится ясно, что одному ассистенту нужен доступ только к KPI и регламентам, тогда как другому нельзя показывать финансовые или персональные данные без их предварительного обезличивания.

Затем проектируется контур источников. Я придерживаюсь простого принципа: у каждого ответа должен быть свой адрес. Если ассистент не может указать источник вывода, этот ответ не должен использоваться в управленческом контуре. В наших проектах хорошо зарекомендовало себя правило: нет цитаты – нет ответа.

Следующий слой – права и журналирование. Ассистент не должен иметь несанкционированного доступа ко всему подряд. Права на чтение следует наследовать от исходных систем, а не назначать заново в RAG. Все чувствительные запросы, загрузки и вызовы инструментов должны тщательно логироваться для последующего анализа инцидентов. Отдельный слой – подтверждение действий. Хороший ассистент никогда не отправляет письмо клиенту, не изменяет статус критичной сделки и не запускает важный процесс безмолвно. Он предлагает действие, объясняет его необходимость и ожидает подтверждения от человека.

Еще один обязательный слой – это DLP (Data Loss Prevention) и политика данных. С ИИ в компании следует обращаться примерно так же, как с корпоративной почтой: установить четкие правила, ограничения и вести понятный журнал. На практике это включает маскирование конфиденциальных полей, предупреждения для пользователей, блокировку запрещенных типов данных, контроль вложений и сроки хранения.

Облако, частный контур и вопрос зрелости

Дискуссию о выборе между облачным и локальным (on-premise) развертыванием часто начинают преждевременно. Сначала необходимо ответить на другой вопрос: какие данные и какие действия вы в принципе готовы доверить ИИ? Для ряда сценариев облако вполне подходит, например, для создания черновиков, суммаризации обезличенных материалов или низкорисковой аналитики. Однако для таких областей, как HR, финансы, юридическая служба, внутренние регламенты, чувствительная клиентская история и сценарии с привилегированным доступом, требования совсем иные. Здесь без частного контура, локализации данных, журналов доступа и прозрачной договорной модели разговор становится слишком рискованным.

При выборе поставщика я обычно обращаю внимание не на размер модели или эффектную демонстрацию. Гораздо важнее приземленные аспекты, которые впоследствии спасают проект: используется ли клиентский контент для обучения модели, где и как он хранится, возможно ли его удаление без затруднений, и какая информация вообще остается в журналах.

С чего начинать

Если компания только начинает свой путь, не стоит сразу стремиться к созданию всеобъемлющего корпоративного агента. Лучше начать с одного узкого сценария, где эффект очевиден, а риски ограничены. Например, ассистент руководителя для утренней сводки, помощник поддержки по регламентам или ассистент продаж для выявления отклонений в воронке. Важно, чтобы он имел разрешенные источники, работал в режиме «только чтение», вел журналирование и обязательно требовал проверки выводов человеком.

На старте многие почему-то мечтают об универсальном ассистенте для всей компании. По моему опыту, это верный путь к быстрому хаосу. Гораздо продуктивнее первые две недели потратить не на погоню за самой модной моделью, а на постановку неудобных вопросов: какие решения мы в принципе готовы доверить машине? Действительно ли у нас есть качественные источники данных? Кто является владельцем сценария? Кто будет разбирать инциденты? И кто нажмет кнопку «стоп», если система начнет работать некорректно? Обычно именно этот разговор показывает, есть ли у проекта шанс на зрелое внедрение или он снова закончится красивым, но нефункциональным прототипом.

Корпоративный ИИ начинает приносить прибыль и экономить время не тогда, когда ему предоставляется максимальная свобода, а когда для него заданы четкие и понятные границы.

Коротко говоря, безопасный ИИ начинается не с выбора самой интеллектуальной модели. Он начинается с грамотной инженерии вокруг нее. Когда у системы есть четкие права, понятные источники, логирование и обязательная человеческая проверка, она действительно помогает. Когда этого нет, компания получает не магию, а очередной источник утечек, ошибок и излишней самоуверенности.